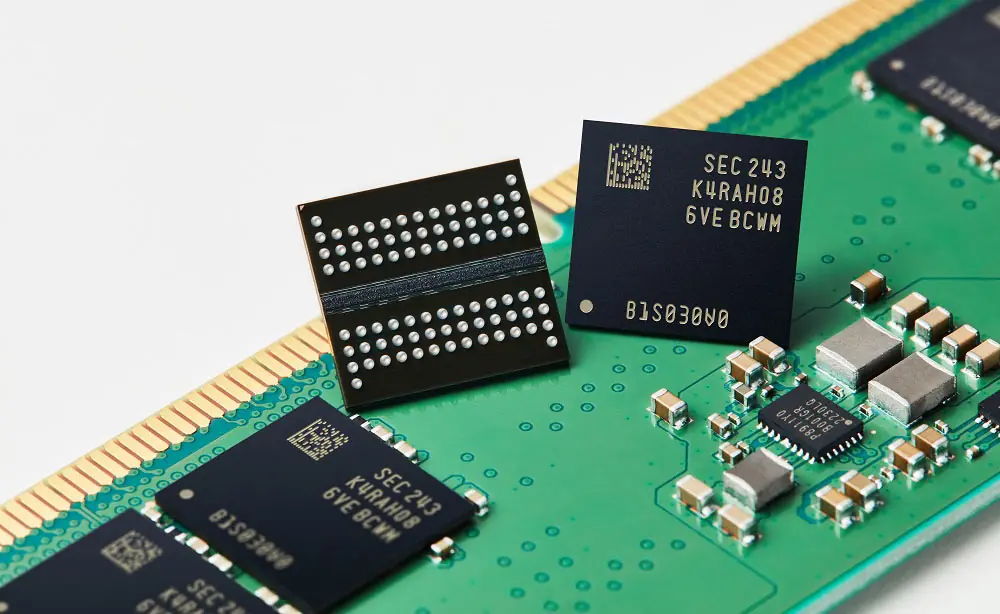

SK Hynix ha ufficialmente avviato la produzione in serie dei moduli di memoria SOCAMM2 da 192GB. Questo importante sviluppo si prepara a ridefinire gli standard di prestazione dei nuovi server AI di prossima generazione, in particolare a supporto della piattaforma Vera Rubin di NVIDIA. I nuovi moduli promettono significativi miglioramenti in termini di larghezza di banda ed efficienza energetica affrontando i colli di bottiglia critici nella formazione e nell'estrazione dei modelli AI.

Punti Chiave

- SK Hynix ha avviato la produzione in serie dei moduli di memoria SOCAMM2 da 192GB.

- Progettato per la piattaforma AI Vera Rubin di NVIDIA, con potenziale supporto AMD EPYC.

- Offre il doppio della larghezza di banda rispetto ai tradizionali RDIMM e oltre il 75% di efficienza energetica.

- Punta a risolvere i colli di bottiglia di memoria nella formazione e nell'estrazione di grandi modelli di linguaggio (LLM).

- La tecnologia SOCAMM2, precedentemente utilizzata nei dispositivi mobili, è ora adattata per ambienti server.

Rivoluzionare le Prestazioni dei Server AI

I nuovi moduli SOCAMM2 da 192GB di SK Hynix sono costruiti utilizzando un avanzato processo 1cnm basato sulla tecnologia DRAM LPDDR5X a bassa potenza di sesta generazione da 10 nanometri dell'azienda. Questo design innovativo aumenta significativamente le prestazioni offrendo oltre il doppio della larghezza di banda delle soluzioni RDIMM tradizionali. Inoltre, questi moduli raggiungono oltre il 75% di efficienza energetica, fornendo un fattore critico per le crescenti esigenze dei data center AI.

Affrontare le Crescenti Esigenze dell'AI

Il passaggio dalla fase di estrazione a quella di formazione nel mercato AI richiede soluzioni di memoria in grado di gestire set di dati di grandi dimensioni e calcoli complessi in modo più efficiente. Il SOCAMM2 di SK Hynix è stato progettato specificamente per affrontare queste sfide. Posizionando il modulo di memoria più vicino alle unità di elaborazione, aumenta l'integrità del segnale e la scalabilità, offrendo vantaggi pratici in termini di estrazione e sostituzione.

Un Nuovo Standard per la Memoria AI

“Con l'introduzione del SOCAMM2 da 192GB, SK Hynix ha stabilito un nuovo standard nelle prestazioni di memoria AI,” afferma Justin Kim, Presidente e CEO Responsabile dell'Infrastruttura AI di SK Hynix. “Collaborando strettamente con i nostri clienti globali nel settore AI, rafforzeremo la nostra posizione come fornitore di soluzioni di memoria AI più affidabile.”

L'azienda prevede che questi moduli giocheranno un ruolo importante nell'accelerare la velocità di elaborazione dei sistemi generali, risolvendo fondamentalmente i colli di bottiglia di memoria riscontrati durante la formazione e l'estrazione di grandi modelli di linguaggio con miliardi di parametri. Si prevede che questo sviluppo ridurrà significativamente il consumo energetico e i costi di raffreddamento nei data center, migliorando in ultima analisi il costo totale di proprietà dell'infrastruttura AI.

Commenti

(3 Commenti)