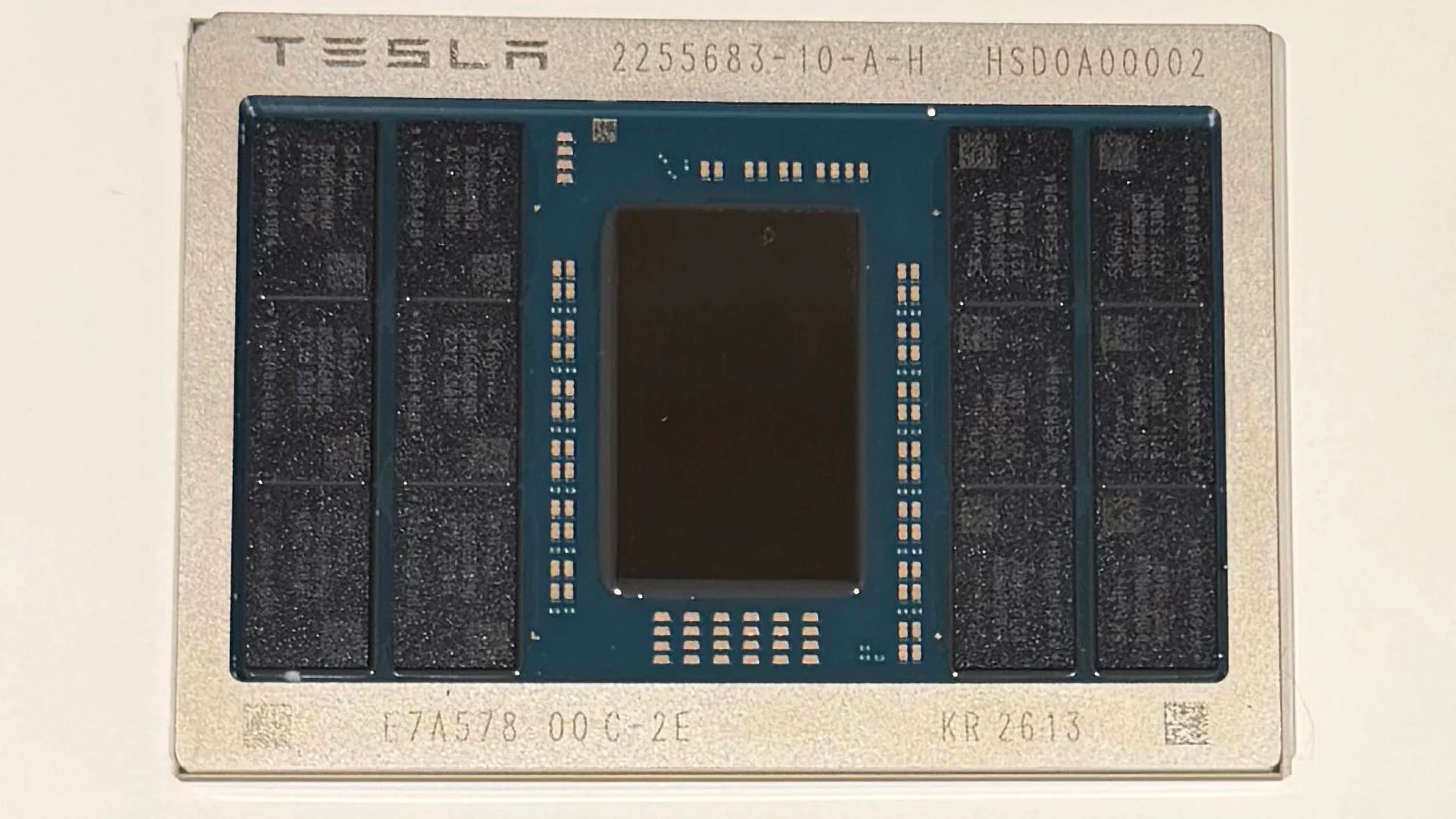

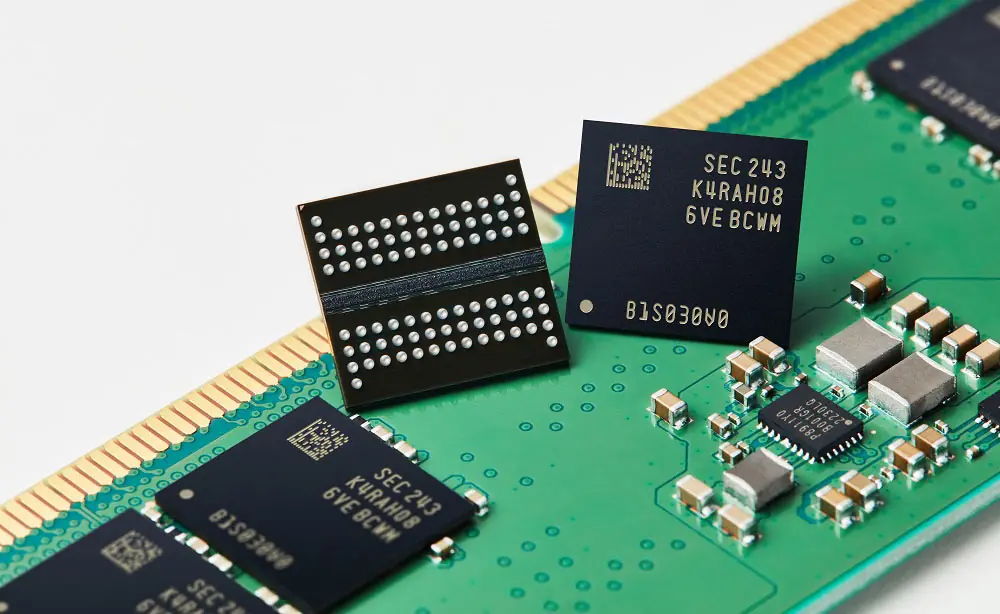

SK Hynix hat offiziell mit der Serienproduktion der bahnbrechenden 192GB SOCAMM2 Speichermodule begonnen. Diese wichtige Entwicklung steht kurz davor, die Leistungsstandards der neuen Generation von KI-Servern, die die bevorstehende Vera Rubin-Plattform von NVIDIA unterstützen, neu zu definieren. Die neuen Module versprechen bedeutende Verbesserungen in der Bandbreite und Energieeffizienz, indem sie kritische Engpässe im Training und der Inferenz von KI-Modellen angehen.

Wichtige Punkte

- SK Hynix hat mit der Serienproduktion der 192GB SOCAMM2 Speichermodule begonnen.

- Entwickelt für die Vera Rubin KI-Plattform von NVIDIA, mit potenzieller Unterstützung für AMD EPYC.

- Bietet im Vergleich zu herkömmlichen RDIMMs die doppelte Bandbreite und über 75% Energieeffizienz.

- Zielt darauf ab, die Speicherengpässe beim Training und der Inferenz großer Sprachmodelle (LLM) zu lösen.

- Die zuvor in mobilen Anwendungen verwendete SOCAMM2-Technologie ist nun für Serverumgebungen angepasst.

Revolutionäre Erneuerung der KI-Server-Leistung

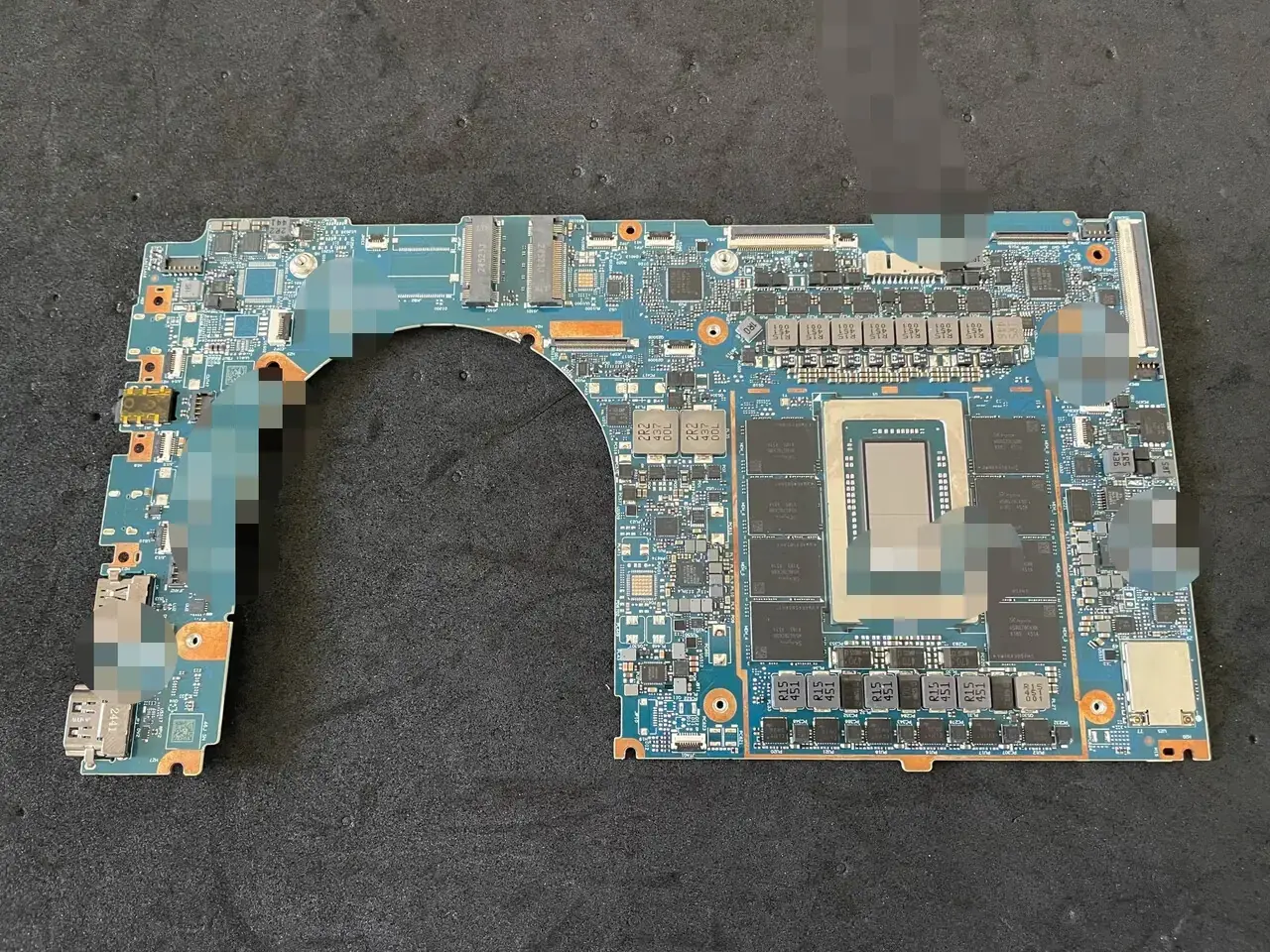

Die neuen 192GB SOCAMM2 Module von SK Hynix basieren auf dem fortschrittlichen 1cnm-Prozess, der auf der sechsten Generation der 10-Nanometer LPDDR5X Low-Power-DRAM-Technologie des Unternehmens beruht. Dieses innovative Design bietet mehr als die doppelte Bandbreite herkömmlicher RDIMM-Lösungen und steigert die Leistung erheblich. Darüber hinaus erreichen diese Module über 75% Energieeffizienz und bieten damit einen entscheidenden Faktor für die steigenden Anforderungen an KI-Rechenzentren.

Steigende Anforderungen der KI erfüllen

Der Übergang von der Inferenz- zur Trainingsphase im KI-Markt erfordert Speicherlösungen, die große Datensätze und komplexe Berechnungen effizienter verwalten können. SK Hynix‘ SOCAMM2 wurde speziell entwickelt, um diesen Herausforderungen gerecht zu werden. Durch die Positionierung des Speichermoduls näher an den Verarbeitungseinheiten wird die Signalintegrität und Skalierbarkeit erhöht, während die Austauschbarkeit und Austauschfähigkeit praktische Vorteile bieten.

Ein neuer Standard für KI-Speicher

„Mit der Einführung des 192GB SOCAMM2 hat SK Hynix einen neuen Standard für die KI-Speicherleistung gesetzt“, sagt Justin Kim, Präsident und CEO von SK Hynix, der für die KI-Infrastruktur verantwortlich ist. „Durch enge Zusammenarbeit mit unseren globalen KI-Kunden werden wir unsere Position als vertrauenswürdigster Anbieter von KI-Speicherlösungen stärken.“

Das Unternehmen prognostiziert, dass diese Module eine wichtige Rolle bei der Beschleunigung der Verarbeitungsgeschwindigkeit allgemeiner Systeme spielen werden, indem sie die Speicherengpässe beseitigen, die beim Training und der Inferenz großer Sprachmodelle mit Hunderten von Milliarden von Parametern auftreten. Es wird erwartet, dass diese Entwicklung den Energieverbrauch und die Kühlkosten in Rechenzentren erheblich senken und letztendlich die Gesamtkosten für die KI-Infrastruktur verbessern wird.

Kommentare

(3 Kommentare)